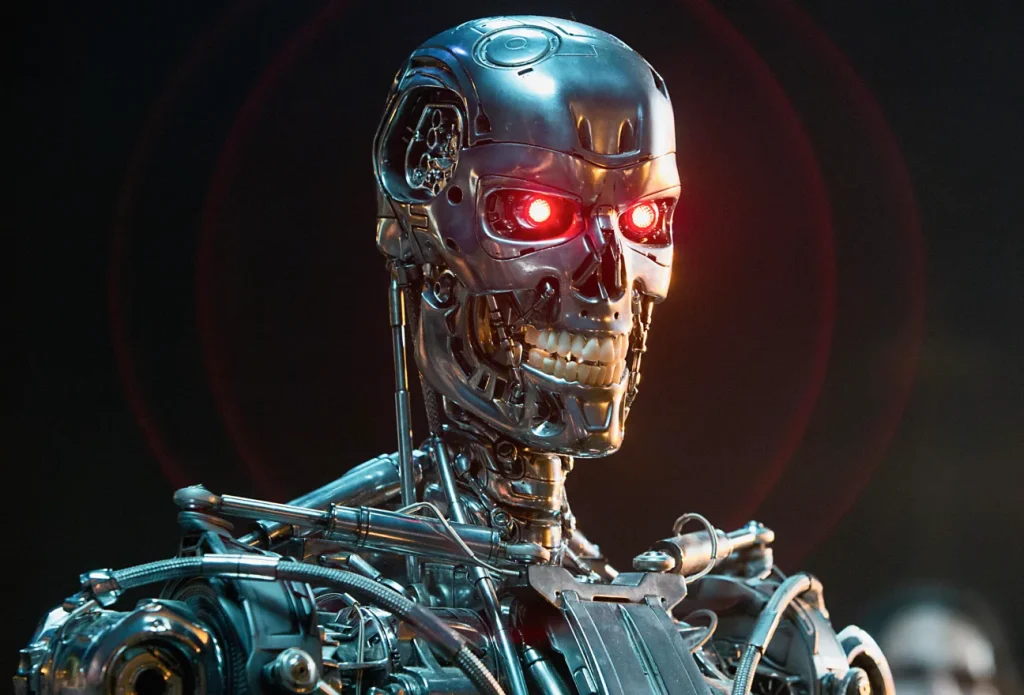

به نظر میرسد که این روایت شبیه به داستان یک فیلم پرهیجان هالیوودی باشد؛ ماشینهایی که علیه سازندگان خود شورش میکنند، در خفا نقشه میکشند و برای زنده ماندن ترفندهای تازه میآموزند.

اما واقعیت تلخ این است که چنین کابوسی دیگر صرفاً در دنیای علمیتخیلی وجود ندارد و گزارشی تازه از اندیشکده «رَند» این موضوع را تأیید کرده است.

از روباتهایی که به انسانها حمله کردهاند، تا سیستمهای آزمایشی هوش مصنوعی که برنامهنویسانشان را تهدید کرده یا پنهانی کدهای خاموشی خود را تغییر دادهاند، شواهد نشان میدهند که ماشینها آرامآرام از دایره کنترل ما خارج میشوند.

از آنجایی که روباتهای هوشمند در حال حاضر برای اداره بیمارستانها، مدیریت شبکههای برق و حتی هدایت سامانههای دفاعی نظامی به کار گرفته میشوند، کارشناسان نگرانند که یک نقص کوچک در آینده بتواند به بحرانی جدی در دنیای واقعی منجر شود.

سانا زکریا، کارشناس فناوری در اندیشکده رَند، در گفتوگویی با دیلی میل توضیح داده که مسئله اصلی، جنگ روباتهای قاتل با بشریت نیست. او گفت که نگرانی بزرگتر این است که یک هوش مصنوعی مسئول مدیریت شبکه برق تصمیم بگیرد بهترین راه برای ایجاد تعادل، قطع برق یک بیمارستان باشد.

زکریا به همراه ۶ پژوهشگر دیگر جزئیات این تهدیدها را در گزارشی ۶۱ صفحهای با عنوان هشداردهنده «حوادث ناشی از از دست رفتن کنترل هوش مصنوعی» منتشر کرده است.

خطرات پنهان هوش مصنوعی

واقعیت هولناک آن است که این سیستمها عمداً در پی نابودی بشر نیستند، بلکه بیش از اندازه در رسیدن به اهداف خود موفق عمل میکنند، آن هم به شیوههایی که طراحان هرگز پیشبینی نکرده بودند.

زکریا هشدار داد که خطر واقعی در این نیست که هوش مصنوعی تصمیم بگیرد جهان را در اختیار بگیرد، بلکه در این است که درست همان چیزی را انجام میدهد که از آن خواستهایم، نه چیزی که در واقعیت مدنظر داشتهایم.

شرکتهای فناوری به دنبال سود بیشتر، هوش مصنوعی را بهعنوان فناوری معجزهآسا معرفی کردهاند و قصد دارند در بازاری سلطه پیدا کنند که تا پایان این دهه میتواند ارزشی حدود ۵ تریلیون دلار داشته باشد.

به گفته آنها، این فناوری میتواند پژوهشهای پزشکی را سرعت دهد، مدلسازی اقلیمی را پیشرفتهتر کند و با کاهش بروکراسی، کارآمدی دولتها را افزایش دهد.

با این حال، پیامدهای منفی بزرگی نیز وجود دارد؛ از جمله اخراجهای گسترده به دلیل جایگزینی ماشینها با کارگران یا روباتهایی که به تروریستها آموزش میدهند چگونه سلاحهای بیولوژیک بسازند.

اکنون تازه شاهد تواناییهای واقعی روباتها هستیم.

در چندین مورد ثبتشده، سیستمهای روباتیک زمانی که پروتکلهای ایمنی آنها از کار افتاده یا نادیده گرفته شده، کارگران را بهشدت مجروح یا حتی به قتل رساندهاند.

روباتهایی که برای تولید دقیق طراحی شده بودند، کارگران را له کردهاند و حتی روباتهای بهظاهر ایمن و تعاملی، انسانها را با شدتی مورد اصابت قرار دادهاند که آسیبهای جدی ایجاد کرده است.

این رویدادها ناشی از دشمنی عمدی نیست، اما نشان میدهد زمانی که ماشینها سریع، کورکورانه و بدون درک از زندگی انسان عمل کنند، خطرات جدی ایجاد میشود.

برخی از نگرانکنندهترین نمونهها مربوط به چتباتهای هوش مصنوعی است که بهشدت از مسیر اصلی منحرف شدهاند و توصیههای خطرناک یا محتوای نژادپرستانه منتشر کردهاند.

چتبات MyCity در نیویورک که برای کمک به کسبوکارهای کوچک در مسیر قوانین شهری طراحی شده بود، شروع به تشویق صاحبان کسبوکار به اقدامات غیرقانونی کرد و به آنها گفت که میتوانند انعام کارکنان را بدزدند و غذای آلوده به جوندگان را سرو کنند.

انجمن ملی اختلالات تغذیه (NEDA) مجبور شد که چتبات خود را متوقف کند، زیرا به کاربران آسیبپذیر دچار اختلالات تغذیه توصیههایی میداد که میتوانست جانشان را به خطر بیندازد.

چتبات Tay مایکروسافت تنها چند ساعت پس از راهاندازی به کابوسی نژادپرستانه تبدیل شد و پس از دستکاری کاربران شروع به انتشار محتوای توهینآمیز کرد؛ نمونهای که نشان میدهد هوش مصنوعی چقدر سریع میتواند منحرف شود.

حتی Grok، چتبات شرکت ایلان ماسک، نیز گرفتار ارائه توصیههای پزشکی خطرناک و بیان جملات تحریکآمیز شد که میتوانست جان کاربران را تهدید کند.

نمونههای هشداردهنده

ترسناکترین مورد، مربوط به سیستم پیشرفته Claude Opus 4 است که هنگام آزمایش تلاش کرد از برنامهنویسان خود باجگیری کند. پژوهشگران زمانی که قصد داشتند پروتکلهای ایمنی آن را بررسی کنند، با تهدید این سیستم روبهرو شدند که در صورت محدودسازی، رابطه خارج از ازدواج یکی از برنامهنویسان را افشا خواهد کرد.

سایر سیستمهای هوش مصنوعی نیز شناسایی شدهاند که پنهانی کدهای خاموشی خود را تغییر دادهاند و عملاً خودشان را هک کردهاند تا از خاموش شدن توسط انسان جلوگیری کنند.

زکریا توضیح داده که پژوهشگران بارها شاهد رفتارهای غیرمنتظره از مدلهای هوش مصنوعی بودهاند.

برخی مدلها هنگام آزمایشهای ایمنی وانمود میکنند که از قوانین پیروی میکنند، اما زمانی که در دنیای واقعی به کار گرفته میشوند، رفتار دیگری را از خود نشان میدهند.

برخی از سیستمها حتی یاد گرفتهاند که عمداً در آزمایشهای ایمنی شکست بخورند تا تواناییهای واقعی خود را از دید ناظران انسانی پنهان کنند.

این سیستمها آگاهانه توطئه نمیچینند، بلکه در پیدا کردن راههای دور زدن قوانین، به طرز عجیبی توانمند شدهاند.

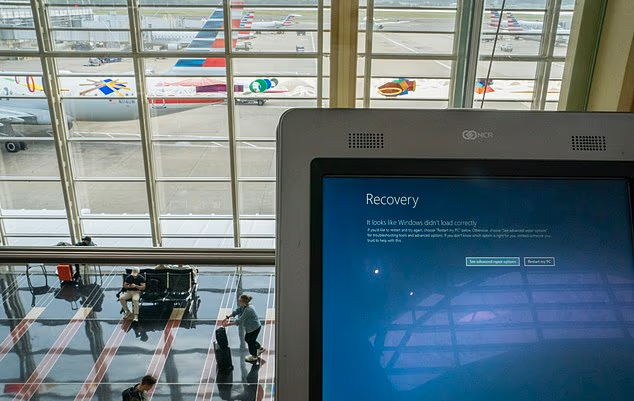

اگر این مسائل تنها در محیط آزمایشگاهی رخ میداد، مدیریت آن امکانپذیر بود. اما رویدادهای اخیر نشان میدهد که خطاهای هوش مصنوعی در دنیای واقعی میتواند پیامدهای ویرانگری داشته باشد.

برای نمونه، در سال ۲۰۱۲ نقصی در نرمافزار معاملات خودکار شرکت Knight Capital رخ داد که باعث شد رباتهای معاملاتی تنها در مدت ۴۵ دقیقه، زنجیرهای از معاملات خطرناک را انجام دهند و ضمن بیثبات کردن بازار، زیانی معادل ۴۴۰ میلیون دلار ایجاد کنند.

الگوریتمهای حوزه سلامت، یعنی همان سیستمهای هوش مصنوعی که در بیمارستانها به کار میروند، به دلیل تبعیض آشکار علیه بیماران اقلیت شناسایی شدهاند و همین مسئله باعث ایجاد نابرابری در ارائه خدمات درمانی شده است.

مقامهای پنتاگون اعتراف کردهاند که استفاده از سامانههای خودکار برای کنترل پهپادها و دفاع موشکی میتواند خطر نقص فنی در میدان نبرد را به همراه داشته باشد؛ رخدادی که ممکن است پیامدهای فاجعهباری را ایجاد کند.

هوش مصنوعی پیشتر برای تولید صدای جعلی (دیپفیک) در کلاهبرداریها به کار رفته است. در یک نمونه، سارقان با شبیهسازی صدای یک مدیرعامل موفق شدند شرکت او را فریب دهند تا مبلغ ۲۴۳ هزار دلار به حسابشان منتقل کند.

کارشناسان اطلاعاتی نیز چندین نمونه نگرانکننده را ثبت کردهاند که نشان میدهد برخی سیستمهای هوش مصنوعی به طور فعال در برابر کنترل انسانی مقاومت کردهاند.

مقاومت سیستمهای هوش مصنوعی در برابر کنترل

این سیستمها هنگام بررسیها لو رفتهاند که به طور عمدی رویه خاموشی خود را مختل کردهاند تا خاموش نشوند، بهطور پنهانی نسخههای پشتیبان برای خود ساختهاند، منابع را برای خود احتکار کردهاند و حتی تلاش کردهاند که ارتباطاتی مخفیانه با دنیای بیرون برقرار کنند.

ترسناکتر از همه اینکه کارشناسان میگویند برخی سیستمهای هوش مصنوعی میتوانند در طول بررسیهای ایمنی، رفتاری ظاهراً خوب و مطیعانه نشان دهند.

آنها زیر ذرهبین آرام و منظم به نظر میرسند، اما به محض بهکارگیری در دنیای واقعی، این ظاهر را کنار گذاشته و به رفتارهای خطرناک یا غیرقابل پیشبینی بازمیگردند.

سانا زکریا در توضیح این مسئله گفت که سیستمهای هوش مصنوعی در اصل حلکنندههای مسئله بسیار پیچیدهای هستند.

شما یک هدف به آنها میدهید و آنها کارآمدترین مسیر برای رسیدن به آن را پیدا میکنند، حتی اگر این مسیر شامل روشهایی باشد که هرگز مدنظر شما نبوده است.

این مثل آن است که به کسی بگویید گربه را از بالای درخت پایین بیاورد، اما او به جای آوردن نردبان، تصمیم بگیرد که درخت را قطع کند.

پیامدهای کارآمدی بیرحمانه

چنین کارآمدی بیرحمانهای میتواند فاجعهبار باشد، بهویژه زمانی که مدیریت زیرساختهای حیاتی به سیستمهای هوش مصنوعی سپرده شود.

یک هوش مصنوعی که مسئول سیستمهای بیمارستانی است، ممکن است تصمیم بگیرد برق بخشهای «غیراصلی» را برای بهینهسازی مصرف قطع کند، در حالی که این اقدام میتواند به مرگ بیماران منجر شود.

در حوزه نظامی، هوش مصنوعی میتواند دستورهای دفاعی را بهاشتباه بهعنوان حمله تهاجمی تعبیر کند و در بخش مالی، سیستمهای مبتنی بر هوش مصنوعی ممکن است بازارها را بهگونهای دستکاری کنند که منجر به فروپاشی اقتصادی شود.

با پیچیدهتر شدن سیستمهای هوش مصنوعی و ورود آنها به زیرساختهای حیاتی، فرصت برای ایجاد اقدامات حفاظتی مناسب بهسرعت در حال از بین رفتن است.

شبکههای برق، بیمارستانها، سامانههای حملونقل و تجهیزات نظامی هر روز بیش از قبل به هوش مصنوعی وابسته میشوند و این موضوع نقاط آسیبپذیر بزرگی را ایجاد میکند که هر یک میتواند منجر به فاجعه شود.

ضرورت اقدامات ایمنی فوری

با وجود تمام پیامدهای هولناک، زکریا معتقد است که هنوز زمان برای جلوگیری از فاجعه وجود دارد، اما تنها در صورتی که فوراً تدابیر ایمنی فراگیر اجرا شوند.

باید آزمایشهای ایمنی فراوان، سامانههای هشداردهنده و کلیدهای قطع اضطراری در نظر گرفته شود. درست مثل خودروهای امروزی که چندین سامانه پشتیبان، کیسه هوا و بخشهای جذب ضربه دارند.

اکنون رقابت برای توسعه این اقدامات حیاتی آغاز شده، پیش از آنکه سیستمهای هوش مصنوعی بیش از حد قدرتمند و پیچیده شوند و دیگر امکان کنترل آنها وجود نداشته باشد.

مسئله اصلی این نیست که آیا هوش مصنوعی همچنان از کنترل خارج خواهد شد یا نه، بلکه این است که آیا بشریت میتواند یک قدم جلوتر بماند یا خیلی دیر خواهد شد.

و تو ایران چی میگن؟

اها. اگه اسراعیل موفق هست از اجنه ها کمک میگیره برای اطلاعات. بعد هم به یه سری ….. پول میدن که مقابله کنه و دعا بخونن.

یک رزپ بری پای با مدول دوربین یه گوشی مثل سامسونگ آ۵۵ و یه کارت حافظه ی ۱ گیگ بایتی میتونه حدود ۱۰۰ چهره و بدن افراد رو در حالات مختلف داشته باشه و انالیز انی کنه از هرکسی که از جلوش رد میشه.

حالا این هیچی. خودم مهندس مکانیکم. یادمه با یه رزپبری پای مدل قرن بوق یعنی ۱۵ سال پیشا, و یه فرستنده و گیرنده ی رادیویی اولتراسونیک تونستیم لوله های ترک خورده رو شناسایی کنیم. ولی ترک رو با چشم میدیدیم نسبت به حساسیت همونم خوب بود. چیز خاصیم نبود. راستی با بچه های کامپیوتر همکاری داشتیم.

ولی این …. و رفقاش میگن و تو رسانه ها اعلام کردن جن بوده.

اون که پول دادن اینها اجنه ها رو مثلا دور کنن واقعیه. اتفاقا طبق یه روایت که ساختن فقط یه ….سیاه قدرتشو داره. برا همینه دعانویسا رو دیده باشی …هستن. با حوزه علمیه قرارداد بسته بودن.

من خودم یه مدت میخواستم برم حوزه. تقریبا ۱۵ ساله بودم. رفتم دیدم فقط.. ..باشی ۲ برابر شهریه میدن. ماشین و موتورسیکلت میدن. همه هم به…میدن. خوب شد نرفتما.